inteligencia artificial | Un estudio de la Universidad de California (UCLA) demuestra que el uso de IA como “copiloto” mejora hasta cuatro veces el rendimiento de pacientes en tareas como mover un cursor o manipular objetos mediante un brazo robótico.

inteligencia artificial | Un estudio de la Universidad de California (UCLA) demuestra que el uso de IA como “copiloto” mejora hasta cuatro veces el rendimiento de pacientes en tareas como mover un cursor o manipular objetos mediante un brazo robótico.

Las interfaces cerebro-ordenador (BCI, por sus siglas en inglés) están dando un salto trascendental gracias a la incorporación de la inteligencia artificial (IA). Estas tecnologías, que permiten controlar dispositivos a partir de señales cerebrales, ahora cuentan con un “copiloto digital” capaz de interpretar la intención del usuario y mejorar significativamente la precisión de los movimientos.

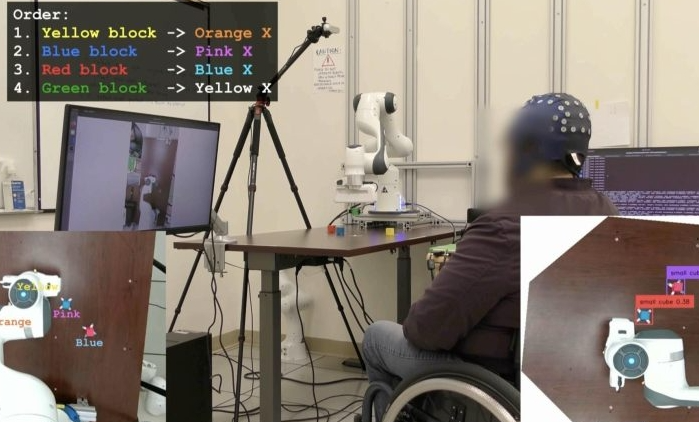

Un equipo de ingenieros de la Universidad de California en Los Ángeles (UCLA) desarrolló una interfaz no invasiva asistida por IA, cuyos primeros resultados se publicaron en la revista Nature Machine Intelligence. Aunque la investigación aún está en fase inicial, los ensayos con un paciente con parálisis y tres voluntarios sin afecciones muestran resultados muy alentadores.

Resultados prometedores

En las pruebas, la persona con parálisis logró un rendimiento 3,9 veces superior en el control del cursor del ordenador respecto al sistema tradicional, y además pudo manejar un brazo robótico para mover bloques de colores a objetivos específicos, algo imposible sin el apoyo de la IA.

Los voluntarios sin parálisis también mostraron mejoras notables: duplicaron su rendimiento (2,1 veces superior) al realizar las mismas tareas asistidos por el “copiloto de IA”.

¿Cómo funciona el sistema?

El dispositivo registra la actividad eléctrica del cerebro a través de un casco con electrodos que realizan una electroencefalografía (EEG). Luego, algoritmos personalizados decodifican las señales cerebrales y extraen aquellas que reflejan intenciones de movimiento.

Posteriormente, estas señales se emparejan con un sistema de visión artificial basado en cámaras, que interpreta en tiempo real la dirección e intención del usuario. De esta forma, la IA no lee movimientos oculares, sino que interpreta la voluntad de acción y ayuda a completarla con mayor precisión.

Un paso hacia la autonomía de personas con parálisis

Jonathan Kao, investigador de la UCLA y coautor del estudio, explicó que el objetivo final es crear interfaces cerebro-ordenador con IA que ofrezcan autonomía compartida, permitiendo que personas con parálisis o enfermedades neurológicas como la ELA recuperen independencia en sus actividades diarias.

Aunque ya existen interfaces cerebro-ordenador de última generación implantadas quirúrgicamente, estas requieren neurocirugía costosa y con riesgos considerables. El modelo desarrollado en UCLA, al ser no invasivo, se plantea como una alternativa más segura y accesible.

El futuro de la neurotecnología

Los investigadores visualizan próximos avances en el desarrollo de copilotos de IA más avanzados, capaces de mover brazos robóticos con mayor velocidad, precisión y destreza táctil, adaptándose a diferentes objetos y situaciones.

Este tipo de sistemas no solo promete mejorar la calidad de vida de millones de personas con movilidad reducida, sino que también podría abrir nuevas posibilidades en el futuro de la interacción humano-máquina.

InformarEs Porque informar es nuestra misión

InformarEs Porque informar es nuestra misión